Notre perception est influencée par le rythme et la nature des informations que nous recevons. Dans le domaine de la technologie en général et de l’informatique en particulier, il est évident que cette perception est saturée par le déluge croissant d’annonces toutes plus sensationnelles les unes que les autres que nous lisons et entendons (subissons ?) quotidiennement…

Les technologies « de pointe » ont fait preuve d’innovations qui ont changé nos modes de vie ces cinquante dernières années, quelquefois en profondeur. Elles semblent responsables d’un flot incessant de nouveautés toujours plus incroyables, qui se succèdent à une vitesse vertigineuse, exponentielle d’année en année. Forcément, on vous serine continuellement qu’il faut suivre le rythme, que tout se transforme très rapidement et qu’on est submergé par ce maelstrom d’innovations, les unes succédant aux autres avec toujours plus d’impatience, n’est-ce pas ?

L’industrialisation croissante semble précipiter la diffusion permanente de ces nouveautés, d’où notre impression d’une accélération du progrès technique. Cette sensation, nous la ressentons tous au point d’y croire vraiment

La plupart des gens vous le diront : “de nos jours ça va trop vite et on a du mal à suivre”. Ils se sont tellement persuadés que ce soit la vérité qu’ils se la répètent et la vivent comme telle. Cette accélération paraît si réelle que personne ne songe à la remettre en cause. Pourquoi ne pas y croire d’ailleurs, puisque tous vos sens semblent vous indiquer que c’est véritablement le cas ?

Mais ça ne fonctionne pas toujours de la sorte. Il y a seulement quelques siècles, les gens dans leur immense majorité pensaient que le soleil tournait autour de la Terre et pas le contraire. Il suffisait de regarder la course du soleil dans le ciel pour se rendre compte qu’effectivement, il en allait ainsi. Votre intuition et votre sens logique vous le confirmaient. Pourtant à cette époque, il était tout à fait logique de penser ainsi et ceux qui affirmaient le contraire étaient très peu nombreux. Aujourd’hui c’est la même chose : tout vous pousse à considérer que le progrès technique s’accélère continuellement.

Donc, posons-nous la question : cette accélération est-elle réelle ou bien est-ce seulement une illusion ?

Pour apporter une réponse claire à cette importante question, j’ai rédigé un livre intitulé “Technologies : perception, illusion, déception”. Dans cet ouvrage, bilans, explications et analyses démontrent que cette progression continue ne se vérifie pas en règle générale et qu’au contraire, la modernisation stagne. Oui, aussi surprenant que cela puisse vous sembler, le progrès marque le pas.

L’ouvrage montre, secteur par secteur (informatique, spatial, militaire, nucléaire et pharmacie) que les progrès sont principalement affaiblis par ce phénomène de la loi des « retours dégressifs ». Bien sûr, il est tout à fait contre-intuitif d’affirmer cela et, au premier abord, personne ne vous croira.

Pourtant, que ce soit pour l’informatique, l’industrie spatiale, le militaire et l’armement, l’industrie pharmaceutique, la biotechnologie, la nanotechnologie ou le transhumanisme, ce livre va vous permettre de constater que concrètement, dans chaque domaine, la réalité est bien plus rugueuse que les discours enflammés et suroptimistes que l’on entend dans tous les médias. Nous allons aussi constater que les progrès, au contraire de ce qui est dit, réclament beaucoup de temps, toujours plus de temps et qu’il faut être patient avant de pouvoir récolter. Pour caricaturer, disons que les fameuses “révolutions techniques en une nuit” ont besoin de vingt ans de maturation silencieuse avant d’enfin exploser à la face du monde… Faisons rapidement un tour d’horizon secteur par secteur pour constater que la situation réelle est loin d’être aussi brillante que présentée dans les médias…

L’industrie spatiale : la stagnation

Dans le secteur spatial, on frôle la caricature : d’un côté, nous avons un domaine qui fait rêver et qui évoque les technologies les plus pointues. Mais de l’autre, nous avons une stagnation inimaginable tant qu’on ne s’est pas penché sur la situation technique.

Cela semble provocateur de parler de stagnation quand on évoque le spatial… et pourtant, c’est le constat le moins sévère qu’on puisse avancer. Pour le dire brièvement, la technologie spatiale des moteurs n’a quasiment pas évolué depuis ses débuts !

Difficile à croire, n’est-ce pas ?

Une base qui remonte aux années quarante

Les moteurs utilisés dans les fusées d’aujourd’hui ne sont pas très différents de ceux mis au point par Von Braun pour les V2 des années quarante… eh oui. C’est tellement vrai que le lanceur russe Soyouz bien connu repose toujours sur un dérivé du V2 allemand. Pourquoi une telle stagnation ?

Tout simplement parce que le domaine spatial privilégie la fiabilité avant tout. Début 2007, plus de 1 700 fusées Soyouz avaient été tirées (depuis la fin des années cinquante) avec un taux de réussite proche de 98 %.

Les fusées sont toujours propulsées par des moteurs à carburant liquide (inventé par Robert Goddart dans les années trente), car c’est une technologie bien comprise, bien maitrisée et qui est relativement facile de faire progresser en capacité. On se retrouve ici dans une configuration proche de l’informatique : on progresse en capacité, mais on reste bloqué dans une forme d’inertie, sans innovation profonde.

L’aviation : les ailes brisées

À la fin des années soixante, tous les espoirs étaient encore permis avec le développement annoncé des avions supersoniques destinés au transport civil. Ce développement eut bien lieu (comment oublier la performance technique que représentait la mise au point du Concorde ?), mais il ne se traduisit pas en succès commercial. Finalement, les trajets à vitesse supersonique pour quelques élus n’étaient pas si désirables que cela et l’industrie tout entière se reporta sur le transport de masse. Les « jumbo-jets » évoluèrent progressivement vers des « bétaillères volantes » et les compagnies « low cost » ont encore accentué le phénomène.

Les winglets, un exemple édifiant

Aujourd’hui, les seules « recherches » concernent l’optimisation de la consommation de carburant, et le moins qu’on puisse dire c’est qu’elles se déroulent à un rythme très lent. Prenons un exemple : les « winglets ».

Il se trouve que j’ai travaillé dans le milieu aéronautique aux débuts des années quatre-vingt et je me souviens très bien de ces appendices que je pouvais voir en photo dans le magazine « Aviation Week Space and Technology » que je lisais fiévreusement à cette époque. Ce progrès technique m’apparaissait comme une évidence et je ne doutais pas que tous les constructeurs et toutes les compagnies allaient l’adopter rapidement. Bien entendu quelques pour cent de gain ce n’est pas énorme, mais vu que la modification était mineure, cela semblait un choix gagnant dans tous les cas. Je dois avouer que j’ai été surpris de voir que cette adoption qui, selon moi, devait prendre quatre ou cinq ans a en vérité pris près de vingt à trente ans !

L’armement : de plus en plus cher, de plus en plus long

Les programmes militaires coûtent de plus en plus cher pour aboutir à des déploiements de plus en plus réduits. À quarante milliards d’euros, le programme Rafale a coûté deux fois plus que le programme Mirage 2000 pour moins d’engins commandés (286 contre 315), huit fois plus que le Mirage F1 (246 avions commandés) et presque 30 fois plus que le Mirage III (438 avions).

De plus en plus lent

Non seulement les programmes d’armement sont de plus en plus coûteux, mais aussi et surtout ils prennent de plus en plus de temps (ce qui explique d’ailleurs qu’ils demandent de plus en plus d’argent). Le “démonstrateur Rafale A” vole le 4 juillet 1986 et le programme est lancé le 26 janvier 1988. Les premiers exemplaires sont livrés à partir du 18 mai 2001 (armée de l’air) et entrés en service en 2002 dans la Marine, soit quinze ans de développement alors qu’il n’en avait fallu que huit pour les programmes précédents (Mirage F1 et Mirage 2000).

Ces délais à rallonge ne sont pas propres à l’aviation ni même au contexte français. Du côté des chars d’assaut, non seulement le char Leclerc a coûté bien plus cher que son prédécesseur l’AMX 30 (le coût d’un char Leclerc est à peu près le triple de l’AMX 30 qu’il remplace), mais il a également demandé beaucoup, beaucoup, beaucoup plus de temps pour être mis au point.

Du côté des Américains, c’est encore pire : les chasseurs à réaction dévorent toujours plus de budget et demande toujours plus de temps à être étudiés, construits et livrés aux unités opérationnelles. Dans ce domaine, les tout derniers programmes F22 et F-35 frôlent la caricature dans des proportions énormes. Le F16 n’avait demandé que quatre ans pour être conçu alors que le F22 en réclama quinze (encore pire pour le F-35 qui devait être moins cher et qui, surprise, ne l’est pas…) !

Le nucléaire : dans l’impasse

Il faut savoir que les centrales nucléaires ont d’abord été conçues et réalisées afin de fournir du combustible enrichi pour les armes atomiques; la possibilité de produire de l’électricité n’est venue qu’après. L’idée était de soigner l’image de l’atome qui, à ce moment-là, était vue uniquement comme une arme de destruction, c’était lors de la fameuse période de “l’atome pour la paix”. D’ailleurs, il a fallu attendre 1954 pour voir une centrale atomique être reliée au réseau électrique, soit presque dix ans après avoir commencé à produire du combustible nucléaire.

Des réacteurs à eau pressurisée

Actuellement, l’essentiel du parc de centrales repose encore sur le principe des réacteurs à eau pressurisée avec deux circuits d’eau de refroidissement, circuit primaire et circuit secondaire qui alimentent une turbine à vapeur. C’est le principe de base et il fonctionne comme cela à peu près partout. Il existe d’autres types de réacteurs atomiques qui sont également capables de produire de l’électricité, sans être pour autant déployés largement.

Il existe différents projets de recherche depuis des décennies qui envisagent des formes complètement innovantes de réacteurs nucléaires, par exemple refroidis au sodium ou au sel fondu; ceux-ci restent essentiellement des projets qui tournent en boucle indéfiniment sans jamais se voir mis en service à grande échelle.

Les médicaments : sous perfusion !

Voilà encore un domaine exemplaire : beaucoup d’argent et de compétences sont disponibles et pourtant, les résultats se font de plus en plus rares, comme si la technique ralentissait (tiens, tiens…).

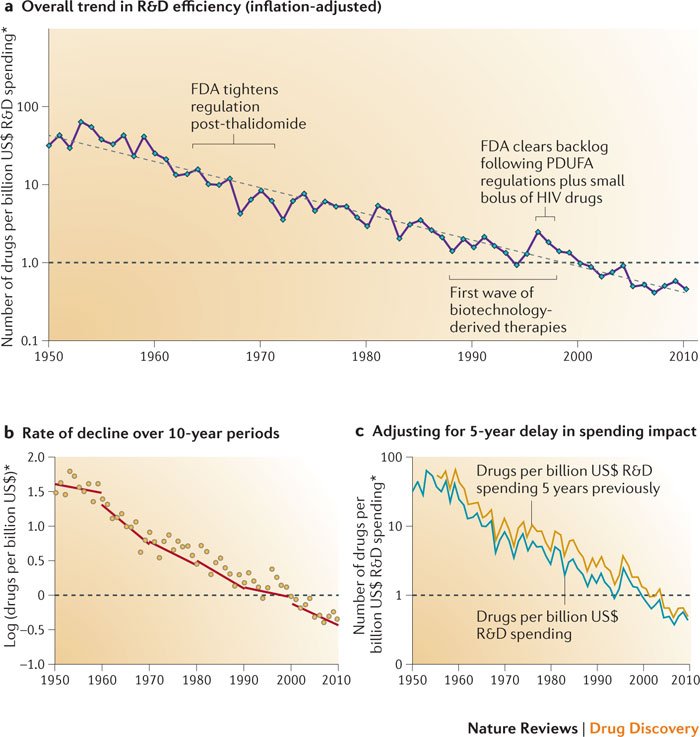

Dans le cadre des médicaments, le phénomène est tellement évident qu’il a même donné lieu à une « loi », la loi Eroom. Le nom Eroom est l’inverse de la loi de Moore bien connue dans le domaine des composants électroniques. Ce nom a été choisi afin de souligner l’effet miroir (inversé donc !) entre l’univers des médicaments et celui des composants.

Le fait que la découverte de nouveaux médicaments ralentit progressivement depuis des décennies est une bonne illustration de la loi des retours dégressifs.

Le principe des retours dégressifs est simple à comprendre. Imaginez un gisement de minerai. On le découvre facilement, car une partie affleure à la surface. Le ramasser en se baissant simplement est alors facile : peu d’efforts et de gros profits. Ensuite, pour continuer à exploiter le filon, il faut mettre en place des techniques de forage et d’exploitation d’une mine en bonne et due forme : galeries, ascenseurs, rails pour faire circuler des wagonnets, mineurs à recruter, former et payer… On comprend très vite que les premiers temps des gains faciles sont déjà loin. Et ça continue ainsi de plus en plus profond, de moins en moins facile jusqu’à ce que le gisement soit épuisé et la mine finalement fermée. Le voilà votre cycle des retours dégressifs : facile et profitable au début et de moins en moins par la suite.

Un secteur qui peine à trouver un second souffle

C’est exactement l’archétype applicable à tous les secteurs déjà étudiés. Dans le cas des médicaments, c’est presque caricatural : tous ceux que nous utilisons aujourd’hui ont été découverts dans les années cinquante, à l’âge d’or des médicaments chimiques. Depuis, en dépit d’efforts colossaux, ce sont toujours les mêmes principes actifs qui sont déclinés à l’infini sous des packaging différents (à l’exemple du paracétamol vendu sous des dizaines d’appellations commerciales diverses), car les affaires restent les affaires, hein !

Et pourtant, depuis le début des années deux mille, les promesses ne manquaient pas pour booster enfin « big pharma » : des médicaments radicalement nouveaux basés sur la « biotech » et le décodage du génome humain. Hélas, il n’en a rien été…

La biotech, une déception abyssale

La biotech (très à la mode à la fin des années quatre-vingt-dix et au début des années 2000) fut l’occasion d’une déception abyssale si on compare les résultats obtenus avec les résultats attendus (et c’est là que se situe le noeud du problème, toujours). Un ami qui travaillait dans le secteur du capital-risque m’a révélé qu’il avait participé à plus de deux cents dossiers liés à la biotech et qu’aucun n’avait produit le moindre retour sur investissement (pas un seul !). Il y croyait à l’époque… il y croit moins désormais !

Le décodage du génome humain (achevé en 2003) lui aussi devait ouvrir la porte aux plus sublimes découvertes… On attend encore !

Avec la biotech et le génomique on est en présence de ce qui s’est révélé être des fausses-pistes, mais qui ont eu droit à un formidable battage médiatique au sommet de leur gloire. Peut-être ces branches finiront par tenir leurs promesses, mais il faudra encore du temps, toujours la même conclusion…

Je n’ai pas repris ici la situation du domaine informatique, car nous l’avons déjà suffisamment détaillé dans mes chroniques sur ce blog (voir https://www.redsen.com/fr/inspired/tendances-decryptees/remettons-les-choses-a-leur-place-en-matiere-dintelligence-artificielle par exemple).

Se débarrasser une bonne fois pour toutes des idées reçues

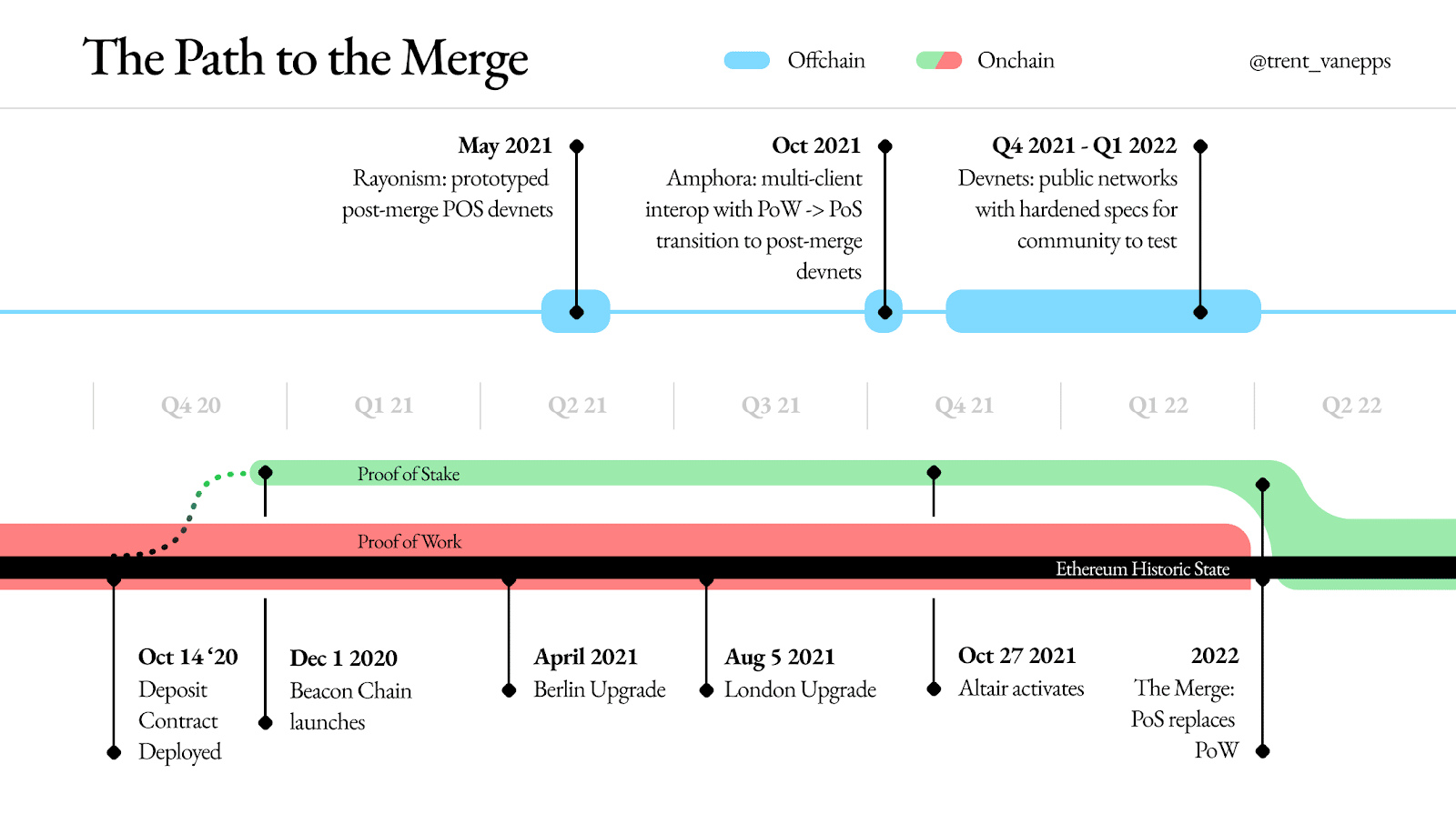

Une fois qu’on est parvenu à se débarrasser de ces idées reçues, une fois qu’on se réhabitue à penser par soi-même, on s’aperçoit qu’il est relativement facile de faire le tri dans les annonces, finalement. C’est comme cela qu’on pose un diagnostic serein sur la “bulle blockchain”. C’est aussi avec cette capacité de réflexion renouvelée qu’on comprend que l’IA ne va pas être “tout pour tout le monde”, en tout cas certainement pas avec l’itération actuelle basée sur le machine learning…

Cette attitude de scepticisme raisonné est la meilleure possible afin d’arriver à identifier les vraies tendances parmi les trop nombreux effets de mode. Prenons de nouveau l’exemple de la voiture autonome. Après quelques années d’annonces enthousiastes, on est passé à un nouveau discours : finalement, cela prendra un peu de temps, cela demande à murir encore… Si on avait intégré le réflexe d’analyser ce qui nous est dit sans être naïf, on saurait prévoir un temps plus long d’adaptation avant une généralisation, quand celle-ci est justifiée.