On commence à en parler de plus en plus sérieusement et il semble qu’il est temps de se poser la question : les ordinateurs “quantiques” sont-ils vraiment sur le point d’arriver et d’être disponibles pour nos usages habituels ?

C’est ce que nous allons voir dans cette chronique :

- qu’est-ce que c’est ?

- c’est pour quand ?

- pour quoi faire ?

- qu’est-ce que ça va changer ?

Bien évidemment, ne comptez pas sur moi pour employer les termes usés du genre “révolution technique”, “rupture qui va tout changer” ou autres exagérations de ce genre qu’on lit hélas trop souvent…

L’informatique quantique, qu’est-ce que c’est ?

Ce concept, imaginé dans les années 1980, est longtemps resté une arlésienne, comparable à la fusion nucléaire dans le domaine de l’énergie. Autrement dit, une approche techniquement différente, promettant de battre (en vitesse d’exécution) les meilleurs supercalculateurs actuels, mais faisant face à de sérieux obstacles pour sa réalisation concrète.

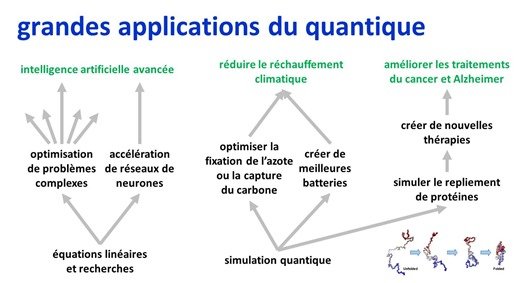

Sur les trois axes que sont le machine learning, la simulation et l’optimisation, sa puissance de calcul exponentielle pourrait résoudre des problèmes bien définis et très complexes.

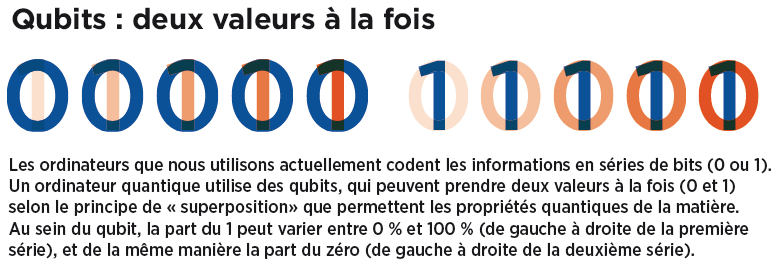

Les ordinateurs quantiques sont effectivement très différents de nos calculateurs habituels basés sur des processeurs séquentiels. Dans ces derniers, l’information est codée avec des 0 et des 1 (les bits d’information) et traitée par des transistors, sorte d’interrupteurs à courant électrique. L’assemblage de plusieurs de ces transistors (en fait, vraiment beaucoup dans les processeurs actuels !) permet de trier les bits, de les ajouter, de les retrancher…

Mais alors qu’un interrupteur est soit ouvert (codant pour 1), soit fermé (codant pour 0), son équivalent quantique (qubit) peut être ouvert et fermé à la fois, et donc valoir 0 et 1 dans le même temps. Ce “qubit”, pour bit quantique, est techniquement une superposition de 0 et 1, une sorte de mélange des deux.

Bon, ça reste difficile à comprendre (et donc à expliquer !), mais cette capacité de superposition permet d’explorer beaucoup plus vite toutes les solutions possibles d’un problème (comme prévoir le prochain coup au jeu d’échecs…).

Le fondateur de Microsoft, Bill Gates, et l’actuel PDG, Satya Nadella, ont participé à une interview avec le Wall Street Journal à la fin de 2017 pour discuter de l’informatique quantique. Bill Gates a déclaré : “Je connais bien la physique et pas mal de mathématiques. Mais le seul endroit où ils montrent des présentations et que je ne vois que des hiéroglyphes, c’est dans le cas du quantique”. Puis le Wall Street Journal s’adressa à Satya Nadella et lui demanda s’il pouvait expliquer le calcul quantique. Il répondit “Non mais je souhaiterais pouvoir le faire !”.

C’est pour quand ?

Même si cela reste de la R&D, nous avons progressé et avons confiance : dans la prochaine décennie, un ordinateur quantique universel sera développé et commercialisé, indique Xavier Vasques, directeur technique chez IBM France.

Si on arrive à traiter les données mille ou un million de fois plus vite qu’aujourd’hui, les entreprises pourront résoudre des questions pour lesquelles elles n’ont aucune solution aujourd’hui. Mais quand cette possibilité sera-t-elle disponible pour les entreprises ?

Là, les estimations des spécialistes varient beaucoup. Cependant, il semble que d’ici trois ans, des services de calcul quantique seront effectivement disponibles sur le cloud. IBM, Microsoft et Google (ainsi qu’Amazon !) y travaillent activement.

Sur tout ce qui est lié à l’utilisation du quantique dans l’intelligence artificielle, on est sans doute sur un calendrier plus long, à plus de cinq ans. On estime en effet que certains problèmes ne pourront pas être résolus tant que l’on n’aura pas atteint des puissances de 100 à 500 qubits (voir encore plus pour certains problèmes). À titre de comparaison, le “IBM Q System One”, premier ordinateur quantique commercial qu’IBM a présenté au CES de Las Vegas en janvier dernier, dispose d’une puissance de 20 qubits. Big Blue prévoit d’atteindre une capacité de 50 qubits courant 2019.

Donc, on comprend bien qu’on n’est qu’au début de cette nouvelle ère et qu’il faut tabler sur du moyen terme avant de la voir s’imposer pour de bon. Car les problèmes à résoudre sont encore assez ardus : refroidissement (du processeur) et stabilité (des qubits) principalement. Actuellement, les processeurs quantiques demandent des températures dignes des premières expérimentations des supraconducteurs, c’est dire !

Et ils ne restent pas stables très longtemps non plus… C’est gênant. La correction d’erreurs est un autre sujet majeur qui prouve bien que cette technologie n’est pas encore “mainstream”. Mais ça va venir, progressivement.

Pour quoi faire ?

En fait, tout ce qui est gourmand en calcul va être “libéré” par cet élargissement (spectaculaire !) des capacités. On pense aux applications scientifiques comme la prévision météo ou la modélisation astronomique… Et les exemples dans le domaine du business sont également nombreux et significatifs : dans le domaine de la santé, cela permettra la simulation et l’optimisation des thérapies. Dans le domaine logistique, l’optimisation des chaînes d’approvisionnement. Dans le secteur banques/assurances, la modélisation des risques et des actifs. Bref, tout ce qui paraissait hors de portée jusqu’à présent va de nouveau être considéré comme “calculable” et les exemples d’applications vont se multiplier une fois que cette “barrière psychologique” aura sauté pour de bon.

N’oublions pas la cryptographie qui va être complètement bouleversée par la disponibilité du calcul quantique : les codes qui semblaient bien protégés (via la cryptographie classique) vont pouvoir être décryptés rapidement. Il faudra donc avoir recours au calcul quantique pour crypter ces codes afin de les protéger à nouveau.

Sans aucun doute, le domaine de la cryptographie va faire un large usage des ordinateurs quantiques.

Qu’est-ce ça va changer ?

Le calcul quantique va provoquer une accélération spectaculaire des processus. Un problème qui aurait pris 330 années via un algorithme sur un ordinateur “classique” ne pourrait demander que dix petites minutes via un système quantique… On voit d’ici les perspectives que ça ouvre !

Rappelez-vous le syndrome de l’avion au décollage : vous pouvez avoir conçu le profil d’aile le plus performant qu’on puisse imaginer, si vous n’avez pas de moteur assez puissant lui correspondant, votre avion va rouler sur la piste, mais ne décollera pas, même avec de multiples tentatives. Et comme il ne vole pas, on ne peut pas se rendre compte que votre aile est ultra performante… CQFD.

On a déjà connu cela avec les réseaux de neurones dans les années quatre-vingt : le concept était connu, mais avait été abandonné, car les ressources système de l’époque ne permettaient pas de le faire fonctionner correctement. Tout a changé avec le cloud et le big data qui ont permis aux réseaux de neurones de révéler leur potentiel qui a débouché sur le machine learning aux résultats spectaculaires souvent évoqués.

L’avènement de l’informatique quantique va sans doute avoir le même type de conséquences : certains concepts avancés vont enfin pouvoir être utilisés, car on ne sera plus limités par les capacités de calcul disponibles. La progression technique va reprendre de plus belle, car le “mur électronique” qui avait fini par remettre en cause la loi de Moore va être oublié : avec les processeurs quantiques, plus de problème de miniaturisation électronique (mais plein d’autres problèmes tout aussi ardus !).

Ceci dit, cela va confirmer une fois de plus que la technique informatique progresse plus facilement en largeur qu’en profondeur : pour prendre une analogie, on peut comparer cette situation à un grand plan d’eau qui s’étendrait toujours plus en superficie, mais resterait peu profond. La surface toujours en expansion représenterait la progression des capacités de traitement (c’est cette progression qui donne l’impression d’une évolution sans frein) et la profondeur serait à l’image des fonctionnalités qui, elles, restent très limitées. Cela ne va pas changer avec l’informatique quantique qui va offrir un grand bond en avant en terme de capacité ce qui va libérer certains contextes applicatifs (mais cela ne peut être assimilé à un approfondissement des fonctionnalités…).

Personne ne comprend la physique quantique – Richard Feynman

Pour finir, revenons sur la difficulté de comprendre tout ce qui a trait à la physique quantique (informatique comprise). Ce domaine est plein de paradoxes, car nous quittons le monde des certitudes pour entrer de plain-pied dans celui des probabilités (où, dans certains cas, toutes les solutions sont bonnes !).

Mais ce n’est pas seulement pour cela que tout ce qui se rapporte à la physique quantique est difficile à comprendre. C’est aussi une question de génération… Songez-y, nous sommes désormais assez à l’aise avec les concepts de magnétismes, d’électricité et même d’électronique. Cependant, ce n’était certainement pas le cas pour “l’honnête homme” du XIXème siècle qui avait toutes les peines à comprendre les explications (alambiquées) des scientifiques de l’époque (comme Maxwell par exemple). Depuis, les explications et les vulgarisations se sont accumulées et nous avons eu largement le temps de nous familiariser avec ces notions (électricité, électronique). Cette phase n’a pas encore eu lieu en ce qui concerne ce nouveau domaine paradoxal (le quantique).

En conclusion, voici deux vidéos pour vous aider à y voir plus clair : la fameuse expérience de la “double fente” qui illustre un des paradoxes du quantique. Et une autre vidéo qui présente assez bien les principes de fonctionnement des ordinateurs quantiques…