On pourrait penser qu’avec tous ces principes clairement identifiés il est désormais possible de facilement prédire l’évolution de l’informatique, mais il n’en est rien !

Certes, connaître ces principes permet d’éviter de se fourvoyer, pourtant il reste difficile de faire des prédictions. La première raison est que certains choix sont spécifiques aux personnes et compagnies de leurs temps. Si Apple n’avait pas inventé l’Apple//, quelqu’un aurait tôt ou tard sorti un ordinateur prêt à l’emploi et l’histoire aurait suivi plus ou moins le même cours. Par contre, les choix d’IBM pour son PC ont été déterminants pour la suite de l’histoire de l’informatique, que ce soit le fait d’utiliser une architecture ouverte ou pour avoir choisi Intel et Microsoft comme partenaires, propulsant ces derniers au rang de nouveaux géants de l’informatique. De même, le fait que Tim Berners-Lee ait décidé contre l’avis de tous les experts de ne pas avoir de base centrale des liens a permis au Web d’être ce qu’il est devenu. Idem pour TCP/IP.

Pourquoi il est difficile de prévoir l’évolution technique

L’expérience passée et les « performances » des prévisionnistes et experts de tout poil suggèrent que nous sommes plus doués à décrire ce que le futur ne sera pas plutôt que d’être capable de distinguer comment il va évoluer.

Pourtant, les prévisionnistes continuent à établir des projections et les experts à proposer leurs « visions » du futur, particulièrement dans les domaines techniques. Il est facile de comprendre pourquoi la prévision est une discipline si peu fiable, voici les raisons principales à cela…

Trop d’optimisme sur le court terme

Nous tendons tous à surestimer l’impact du changement sur le court terme. Bien que le changement soit inévitable, il est difficile de mesurer avec précision quel sera le rythme de ce changement. Ainsi, tout le monde est capable de distinguer une montagne au bout de la vallée, mais bien peu sont capables d’estimer avec justesse quelle est la taille de cette vallée… Appliquer concrètement, cette erreur d’estimation tend à nous faire prédire que des nouveautés techniques vont changer nos vies bien avant qu’elles produisent un impact réel et profond. C’est pour cela que Bob Taylor, un des membres du projet Arpanet, pensait (en 1966, au moment où la décision de mettre en place Arpanet) que le réseau présenterait un bon état de maturité dès 1980 alors qu’il lui fallut effectivement quinze ans de plus !

Trop de timidité sur le long terme

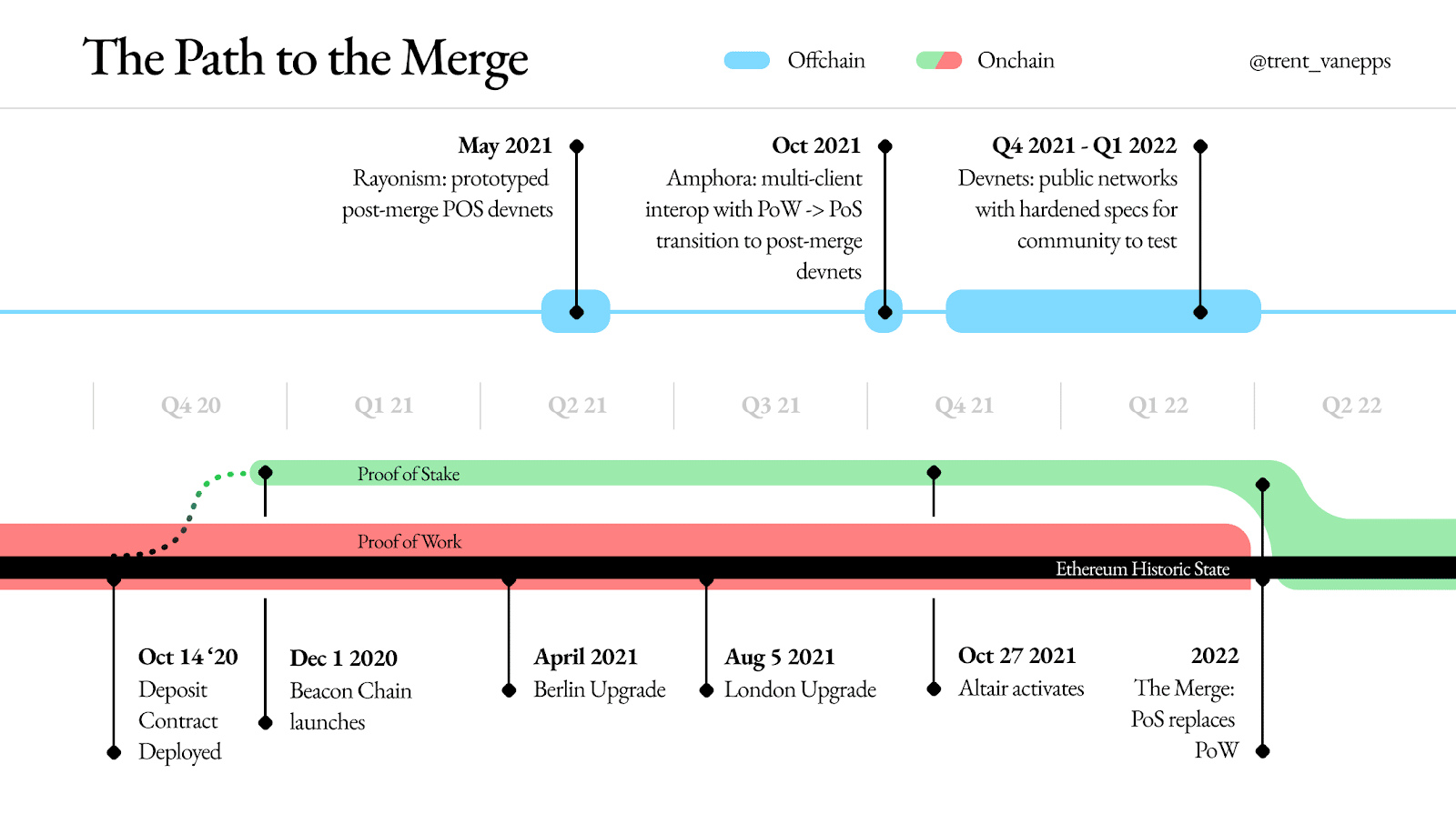

L’autre erreur commune est exactement à l’inverse de la première : nous sous-estimons trop l’ampleur des changements qui peuvent arriver sur le long terme. Lorsque les percées finissent par arriver et produisent leurs effets, le résultat est bien souvent fort différent de ce qui était attendu. Les tenants du mainframe n’ont pas été surpris de l’apparition du PC, mais ils n’avaient aucune idée de l’impact que ce dernier allait avoir sur l’industrie (ils se contentaient de le considérer comme un terminal doté d’un peu de capacités de traitement). Bob Taylor avait bien imaginé le développement planétaire d’Internet et la généralisation de l’usage de l’email, mais il est aussi le premier à reconnaître qu’il a été très surpris par l’apparition puis par le développement explosif du Web. Pareil pour la généralisation de l’usage des smartphones : lors de la sortie de l’iPhone en 2007, peu auraient pu prévoir un tel développement en aussi peu d’années !

Plus une prédiction est précise, plus elle est fausse

Annoncer que le marché boursier va monter est généralement plus sûr (surtout sur le long terme !) que de dire la même chose de tel ou tel titre en particulier. Ce qui est vrai des marchés financiers se vérifie tout autant dans le monde de la technique… C’est pour cela qu’il est plus facile de prévoir que les clients vont acheter toujours plus de capacités de stockage que de pouvoir préciser quelle sera la nature de ces dispositifs (magnétique, SSD, optique, autre ?) ou pire, qui sera le fabriquant qui va bénéficier de cette expansion. D’où une autre chose très difficile à prédire : l’utilisation que l’on va faire d’une technologie. Internet existe depuis des décennies, mais ce n’est que depuis l’arrivée du Web que le grand public l’a adopté en masse. Et même, lors de l’explosion du Web, personne n’a pu prédire la manière dont ce dernier serait utilisé.

Pour ce qui est de la programmation informatique, beaucoup des espoirs ont été annihilés par l’utilisation des logiciels. En particulier, l’un des plus grands souhaits de l’informatique a été la réutilisation de code, évitant de constamment réinventer et “débugger” la roue. Dans les années quatre-vingt/quatre-vingt-dix, l’avènement de la programmation-objet a amené beaucoup d’experts à prédire « la fin de la programmation », pensant que l’avenir de cette dernière ne serait qu’une question d’assemblage de briques. Le grain de sable est venu de la manière dont on utilise les programmes. S’il existe de nombreux programmes génériques (de Windows aux navigateurs Web), dès que l’on passe aux besoins d’entreprise on s’aperçoit qu’il y a autant de besoins que d’entreprises. Imaginez que chaque maison ait besoin d’avoir des briques d’épaisseurs et de tailles différentes. Cela compliquerait grandement la fabrication des briques. C’est un peu ce qui se passe en informatique d’entreprise : les besoins d’une compagnie sont très souvent presque identiques à ceux d’une autre, mais pas tout à fait, les deux compagnies étant organisées de manière différente. Les développeurs se sont aperçus que les « briques » informatiques ne collaient quasiment jamais à leur besoin, et qu’il était toujours plus difficile de réutiliser du code déjà écrit qu’initialement pensé. C’est pour cette raison que la fin de la programmation n’est toujours pas envisageable.

Si prédire les performances d’une technologie donnée n’est pas forcément facile, elle est cependant parfois possible. La loi de Moore, tout empirique qu’elle soit, a été (et reste) un outil influent pour estimer la puissance future des ordinateurs (ainsi que beaucoup d’autres choses). La plus grosse difficulté est que notre cerveau peine à rationaliser des gains en performance lorsqu’ils sont exponentiels. Même avec du recul, il reste difficile de concevoir qu’un Cray 2 (l’ordinateur le plus puissant au monde de 1985 à 1990) soit moins puissant qu’un PC standard produit quinze/vingt ans plus tard !

Le biais des passionnés et des experts

C’est une caractéristique humaine : on a tendance à prédire ce que l’on désire voir arriver. Beaucoup des promoteurs d’une technologie ne voient que les avantages de cette solution, mais oublient les inconvénients. Notre monde est complexe, et certaines actions ont un effet contraire à celui espéré. Prenons l’exemple du « bureau sans papier » : grâce à la bureautique moderne, on n’aurait plus besoin de papier. Mais on a été obnubilé par les avantages de la bureautique (la possibilité de copier/coller et de corriger à volonté) pour oublier les avantages du papier : plus agréable à lire, à manipuler et que l’on peut griffonner. À tel point que la bureautique a finalement consommé toujours plus de papier.

De la même manière, nombreux ont été ceux qui ont vu la fin de Microsoft et de MS-DOS/Windows. OS/2 (version 1.0), Linux, le PowerPC, etc. Or ceux qui ont prévu la fin de Windows n’ont vu que les inconvénients de ce dernier (les bugs, l’instabilité, etc.), mais n’ont pas vu son avantage : la compatibilité avec l’existant. Linux est promis à un bel avenir. En attendant, il n’est pas près de faire mordre la poussière à Windows. Car c’est un autre biais trop commun : celui de voir les innovations comme des remplacements des techniques existantes (voir le principe de compétitivité). Pour être compétitive, une technique doit proposer un élargissement des usages plutôt que de vouloir remplacer telle ou telle technique qui s’est imposée depuis des années et qui fonctionne bien.

Beaucoup de personnalités de l’informatique ont lancé des prédictions qui les arrangeaient. Pas d’avenir pour les baladeurs MP3 disait Bill Gates (avant que Microsoft ne sorte le Zune), le Network Computer qui remplace le PC (Larry Ellison y tenait beaucoup), etc. Si une compagnie investit des millions dans une technologie, elle sera beaucoup plus à même de prévoir un avenir radieux à cette technologie un an plus tard que si c’était une autre compagnie qui l’avait développé.

Les évolutions technologiques sont tout sauf linéaires

Un autre facteur est qu’une technologie ne progresse jamais linéairement, mais par à-coups. Toute technologie commence par progresser puis se heurte à un mur dans son évolution que seule une percée technologique permet de dépasser. Certaines technologies au départ prometteuses s’avèrent être finalement des impasses. Jusque dans le milieu des années quatre-vingt, tous les romans de science-fiction imaginaient qu’en l’an 2000 tout le monde se rendrait au travail à bord de sa soucoupe volante personnelle. Par contre, pas d’Internet et pas de téléphone cellulaire (tout juste quelques talkies-walkies). Vingt-cinq ans plus tard, on reste très loin d’engins spatiaux personnels. L’informatique au contraire a évolué au-delà des imaginations les plus folles.

La raison est que la conquête spatiale s’est heurtée à un mur technologique qu’elle n’a toujours pas réussi à percer. Les fusées restent fondamentalement les mêmes que celle qui a lancé Spoutnik et ne sont toujours pas fiables. Si l’informatique a explosé, c’est en grande partie grâce à deux inventions : le transistor et le microprocesseur. Ce sont ces inventions qui ont permis de se passer des lampes à vide, encombrantes et peu fiables. Sans ces deux inventions, pas d’électronique et sans électronique, pas d’ordinateur moderne.

L’informatique pourrait elle aussi se trouver face à un mur technologique

Cela ne veut pas dire que les ordinateurs ne vont pas se heurter à un mur eux aussi. La loi de Moore, loi empirique qui dit que la puissance des processeurs double tous les dix-huit mois, a perduré plus de temps qu’espéré (plus que Gordon Moore lui-même ne l’avait imaginé). Cela ne veut pas dire qu’elle va continuer éternellement. Par exemple, si la fréquence des processeurs de PC a explosé dans les années quatre-vingt-dix (de quelques dizaines de MHz pour dépasser le seuil du GHz), elle n’a que très peu augmenté cette décennie pour plafonner vers les trois Gigahertz. Au-delà, la chaleur fait littéralement fondre le processeur. Peut-être arriverons-nous un jour à inventer un mécanisme de refroidissement à base d’hélium pas cher et pratique… Ou peut-être pas. En attendant on contourne le problème en utilisant la technologie multicœurs : les processeurs doubles, voire quadruples, cœurs. D’autres types de processeurs sont également à l’étude. Processeurs utilisant un rayon laser au lieu d’électricité (on évite les problèmes de chaleur) ou processeurs quantiques. Mais on est encore très loin d’une application industrielle.

Même un hypothétique processeur quantique ne changerait pas la donne rapidement. Étant une technologie disruptive, un tel type de processeur mettrait du temps avant de rivaliser avec les derniers Intel ou AMD. En d’autres termes, toutes les prédictions précises dans le domaine technique sont et restent peu fiables. Comme si toutes ces difficultés naturelles ne suffisaient pas, il se trouve que ceux qui font profession des analyses prospectives nous servent quasiment toujours des prévisions délirantes. Ces erreurs de jugement seraient comiques si elles n’entraînaient pas avec elles des mouvements d’investissements qui eux peuvent se révéler désastreux. On l’a vu au début des années 2000 avec l’éclatement de la bulle Internet. À cette occasion, les analystes ont été montrés du doigt et accusés de dire n’importe quoi avec un bel ensemble. Le plus surprenant dans cette histoire, c’est bien que l’on soit surpris par le côté charlatanesque de ces rapports d’études prospectives, car cela fait des décennies que c’est ainsi !

Les prédictions volontairement exagérées

Il existe également des prédictions qui sont volontairement exagérées. Tout d’abord, les experts et journalistes ont tout intérêt à parler de « révolution », c’est ce qui attire l’attention. Les vendeurs des nouvelles solutions y trouvent parfois leur intérêt propre. Si Sun a sauté pieds joints sur la « nouvelle économie » c’est que ça aidait ses ventes en jouant sur la peur d’un phénomène à l’époque encore peu compris. Et puis il faut avouer que nous autres spectateurs avons également une part de responsabilité. Nous nous laissons en effet trop souvent entraîner par le piège de la séduction du mot « révolution »…

L’exemple significatif d’OS/2

Des erreurs répétées par toute cette profession ont déjà été commises à de nombreuses reprises. Le cas le plus significatif reste lié à OS/2. En 1988, IBM lance OS/2, un système d’exploitation qui devait effacer MS-DOS des mémoires. Tous les cabinets d’études publient alors des prévisions chiffrées sur les futures parts de marché du nouvel OS et toutes tablent sur un succès rapide et écrasant. On sait ce qu’il en a été : OS/2 n’a jamais remplacé MS-DOS, c’est plutôt Windows qui s’en est chargé… Pour comprendre pourquoi tous ces brillants analystes se sont ainsi lourdement trompés, il suffit de savoir que c’est IBM qui finançaient ces études sérieuses et se contentant de formuler la question ainsi « à partir de quand et à quelle vitesse OS/2 va-t-il remplacer DOS ? ». Évidemment, vu comme cela, on comprend mieux que les réponses soient toutes allées dans le même sens. Gageons que des études basées sur une question formulée de façon différente (comme « OS/2 a-t-il la moindre chance de remplacer un jour ce bon vieux MS-DOS ? ») auraient donné des résultats radicalement opposés (surtout si elles avaient été financées par Microsoft) !

Des principes fondamentalement utiles

Si les principes que nous venons de détailler ne permettent pas de produire des prédictions fiables et précises, ils restent tout de même très utiles pour faire le tri dans le flux des annonces qui se succèdent. Armé de ces principes, vous serez vite capable de repérer les nouveautés qui sont potentiellement intéressantes (même si vous savez déjà que toutes ne vont pas aboutir…) des annonces qui font du bruit, mais n’ont pas d’avenir (un indice pour repérer ces dernières : les alliances entre grands acteurs portent rarement le moindre fruit…).