Le principe N°1 concerne le délai, le temps nécessaire pour qu’une innovation soit convertie en un produit, soit mise au point, trouve son marché et sa forme finale. La perception habituelle est que tout va de plus en plus vite, trop vite même parfois. Mais ne confondons pas perception avec réalité car, contrairement ce qu’on croit, il y a un délai incompressible entre l’apparition d’une technique, sa transformation en produit et son impact réel sur notre quotidien et nos habitudes.

Si l’évolution technique continuait à progresser à la vitesse que l’on a connu au XIXe siècle, il n’existerait plus aujourd’hui de délai entre une découverte et sa mise en application. Quelques exemples puisés dans les technologies de l’époque, aux États-Unis : il a fallu attendre soixante-dix ans pour que le téléphone bénéficie à 50% de la population américaine et trente-neuf ans pour que la télévision par câble atteigne ce taux, alors que seulement onze ans ont été nécessaires pour la radio… L’apogée est atteint avec le microprocesseur pour lequel, entre la première réalisation de Marcian Hoff et Federico Faggin en 1969 et sa diffusion massive via le micro-ordinateur en 1977, il s’écoule moins de dix ans. Personne n’a fait mieux depuis la fin des années soixante-dix.

Un délai incompressible

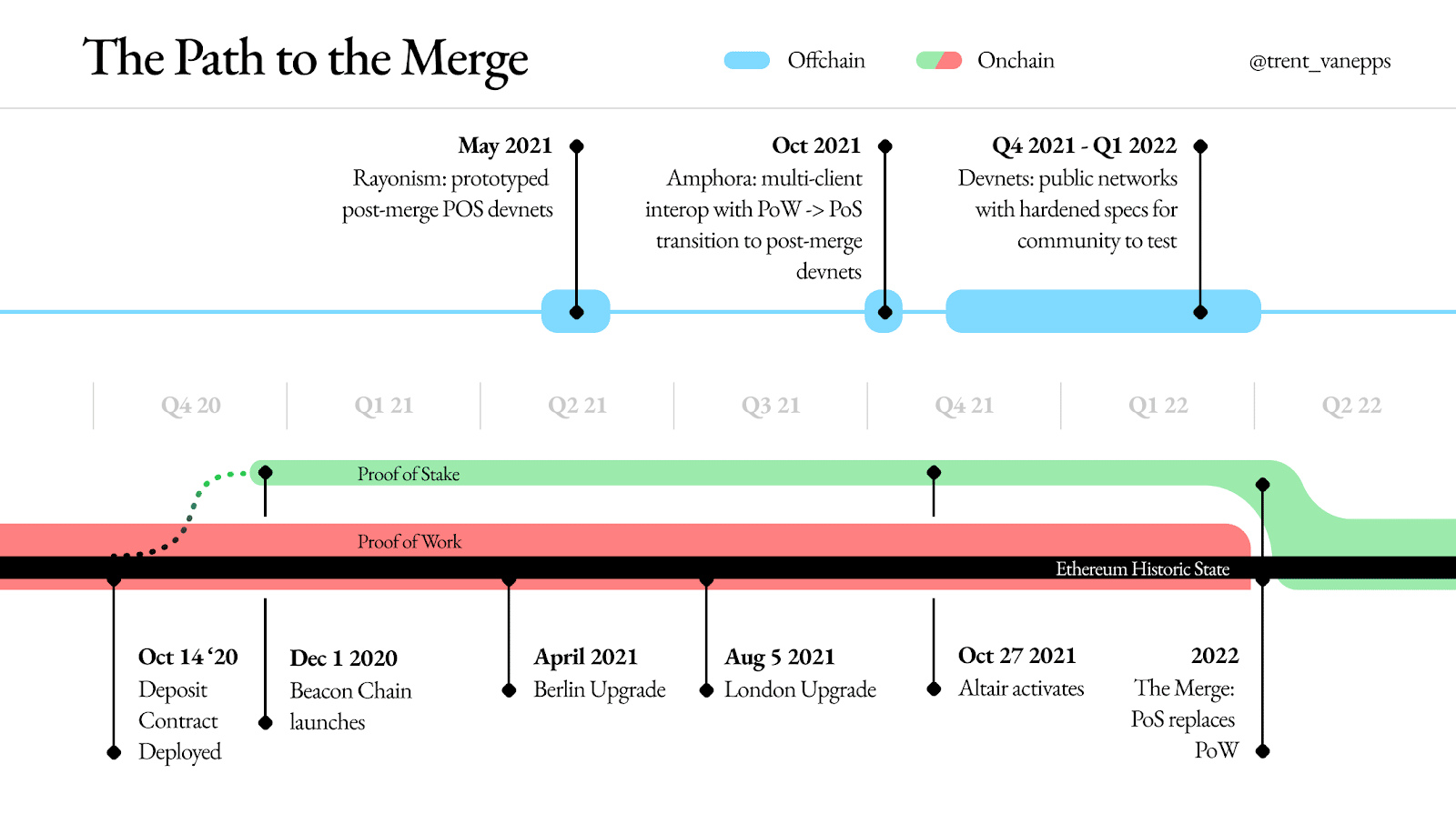

Une décennie, le voilà notre délai incompressible, le time to market cher aux industriels. Vérifiez, depuis le début des années soixante-dix, il faut au moins une dizaine d’années pour qu’une véritable innovation technique commence à trouver un marché et à toucher un public. Et il faut au moins encore autant de temps pour qu’elle devienne incontournable. Une génération est nécessaire pour changer les habitudes des utilisateurs et qu’ils adoptent des innovations dans leur quotidien (c’est comme pour l’aviation commerciale, elle existe depuis quelques dizaines d’années, mais n’est réellement à la disposition des masses que depuis peu).

Il est donc juste de dire que les évolutions significatives sont lentes et relativement peu fréquentes. En dépit de notre obsession pour la nouveauté technologique, les vraies révolutions sont en réalité beaucoup plus rares que l’on imagine. Le progrès de l’informatique ne passe pas par des ruptures. C’est plutôt un travail cyclique, où l’industrie et les utilisateurs remâchent le même concept deux, trois, quatre fois de suite, avant de sortir enfin une version suffisamment robuste pour s’imposer comme standard, normalisé. Et l’histoire montre que ce processus prend souvent au moins vingt ans…

Vingt ans de délais pour les grands succès

Il a fallu vingt ans pour que les interfaces graphiques commencent à se populariser. Les premières recherches de Xerox datent des années 1970 et le succès de Windows 3.0 n’arrive que dans les années 1990. Il a fallu également vingt ans pour que le SGBDR se généralise entre les premiers travaux de recherches d’IBM et le succès d’un Oracle. Dix ans pour que les écrans à matrices actives concrétisent le rêve de l’écran plat à haute définition. Une dizaine d’années aussi pour le début de généralisation des réseaux locaux alors qu’on leur prédisait un avenir fulgurant. Et dix ans encore pour que France Télécom se décide à diffuser Numéris à des tarifs acceptables !

Le délai incompressible combine plusieurs facteurs :

- Il faut du temps pour finaliser la mise au point (difficulté toujours minorée, mais la réalité est tenace et se rappelle au souvenir des optimistes à ce moment-là…).

- Il faut du temps pour passer du discours technologique (c’est supérieur parce que…) au discours applicatif (cela va vous servir à…).

- Il faut du temps pour que la cible visée se reconnaisse.

- Il faut du temps pour que les clients se familiarisent avant de généraliser (la plupart ont déjà essuyé des plâtres trop frais et n’ont plus envie de jouer les pilotes d’essai !).

La masse critique

Les évolutions les plus marquantes et les plus structurantes restent discrètes jusqu’à leurs percées. Un progrès n’apparaît pas spontanément, il est le fruit d’une lente maturation qui s’étale souvent sur une décennie (voire plus). Reprenons l’exemple d’Internet qui est très significatif sur ce plan…

Une croissance silencieuse

Pendant presque quinze ans, Internet a progressé discrètement, mais pas secrètement. Pourtant, personne n’en parlait. Il aura fallu l’émergence du Web en 1993-1994 pour que la croissance bondisse soudainement vers le ciel, à la surprise générale. La signification de ce phénomène est simple : les emballements de demain sont en préparation aujourd’hui, sous nos yeux. Il suffit donc de repérer les techniques prometteuses qui progressent régulièrement, sans accident de parcours, pour mettre le doigt sur les succès d’avenir.

Un emballement bénéfique

Il faut qu’il y ait un enthousiasme flagrant pour que l’emballement surgisse, c’est l’engouement des passionnés et adopteurs précoces qui le déclenche. Un exemple : l’Apple// a été l’amorce de la fusée « micro-informatique ». Pour que les deux Steve décollent, il a fallu des efforts longs et soutenus de toute une génération de fervents adeptes, depuis les ingénieurs d’Intel, jusqu’aux concepteurs de CP/M, sans oublier les promoteurs du Basic, même si l’Apple// ne reposait sur aucun de ces trois composants !

Le phénomène d’emballement est comparable à la réaction en chaîne qui suit la réunion de la masse critique : il est à la limite du contrôlable. Ce phénomène est pourtant nécessaire afin d’assurer un retentissement suffisant à la nouvelle technique pour que sa diffusion ait véritablement des effets sur notre quotidien. Sans cela, la technique est confinée à une relative confidentialité qui interdit les impacts à grande échelle.

Attention à la fenêtre de lancement

Le non-respect du principe de la masse critique (attendre qu’une technique soit dans sa configuration favorable et qu’elle ait commencé à rassembler une bonne dynamique, le fameux momentum cher aux américains) est fréquent dans l’informatique, car les grands acteurs sont trop avides de nouveautés spectaculaires pour se montrer patients. Pourtant, on peut tuer une technique prometteuse en la révélant trop tôt à l’appétit du public (comme on l’a fait avec les disques magnéto-optiques). Il existe donc une période de temps limitée pendant laquelle une technique doit faire ses preuves et fournir des exemples concrets de son utilité et de sa maturité. Cette période dure entre dix-huit et trente mois, pas au-delà. Cet obstacle est d’autant plus redoutable que l’attente est importante. Si l’accompagnement médiatique d’une nouvelle technique est exagéré, alors il s’ensuit un inévitable mouvement de balancier, tout aussi exagéré, pour sanctionner la légitime désillusion du public…

Car celui-ci n’est pas patient, l’hystérie de la découverte enthousiaste se transforme vite en déconvenue qui débouche sur un rejet immérité et prématuré. La déception est fatale, car elle influence le non-renouvellement des crédits, encore nécessaires pour parfaire la mise au point de la technique en devenir. C’est ce type « d’accident de parcours » qui est arrivé à l’intelligence artificielle à la fin des années quatre-vingt et qui faillit lui être fatal.

Le poids des infrastructures

S’il faut plus ou moins une décennie pour franchir toutes ces étapes et commencer la diffusion d’une invention, il en faut environ le triple pour atteindre le seuil de généralisation. Le temps nécessaire à une technique pour atteindre ce stade dépend aussi de ce qu’il réclame; les inventions nécessitant une infrastructure lourde sont forcément plus lentes à impacter leur marché.

L’analogie du lac peu profond

Il serait tout aussi erroné de prétendre que l’industrie informatique est restée figée lors de ces cinquante dernières années. Pour prendre une analogie, on peut comparer ce domaine à un grand plan d’eau qui s’étendrait toujours plus en superficie, mais resterait peu profond. La surface toujours en expansion représenterait la progression des capacités de traitement (c’est cette progression qui donne l’impression d’une évolution sans frein) et la profondeur serait à l’image des fonctionnalités qui, elles, restent très limitées.

La différence entre perception et réalité s’explique par l’ignorance du public qui ne voit rien ou presque de la phase de maturation; les nouveautés semblent surgir du jour au lendemain alors qu’elles viennent de passer des années de mises au point lentes et chaotiques. L’iPhone d’Apple apparait comme un coup de tonnerre dans un ciel bleu en 2007 alors que l’idée du Smartphone était dans l’air depuis 1995 avec General Magic…

Une situation contrastée qui n’est pas une anomalie

Cette dichotomie pourrait passer pour une anomalie, mais c’est là qu’il faut comprendre que l’accroissement des capacités vient surtout des progrès réalisés dans le domaine de l’électronique (comme le montrent les lois de Gordon F. Moore, voir à http://fr.wikipedia.org/wiki/Loi_de_Moore). L’informatique profite donc de ces progrès permanents, mais du coup, le logiciel est toujours en retard par rapport aux avancées du matériel (par exemple, quand les serveurs passent aux processeurs 64 bits, il faut un certain temps -qui se chiffre en années- avant que les logiciels systèmes soient capables de les exploiter et c’est ensuite au tour des logiciels applicatifs de se mettre à niveau… Cette évolution séquentielle est toujours lente alors que, de leur côté, les composants continuent à progresser en permanence). Or, c’est bien au niveau du logiciel que se font les vraies avancées en matière de fonctionnalités…

Le logiciel est forcément en retard sur le matériel

Il ne s’agit pas de dire que ceux qui s’occupent du matériel sont des génies et que ceux qui programment les logiciels sont des ânes !

Pour expliquer la lenteur des progrès côté logiciel, il faut mettre en avant le rôle des tests. Ecrire un logiciel est -relativement- rapide, mais le mettre au point est terriblement plus lent… Les tests logiciels sont lents et complexes. Lents, car il y a de nombreuses possibilités à vérifier et il faut tout revérifier à chaque modification (tests de non-régression). Complexes car le contexte est important et pour un logiciel système (par exemple), il faut pouvoir tester chaque plate-forme dans toutes les configurations possibles… On imagine vite ce que cela représente !

Logiciels et turbines à gaz, même combat !

Prenons un exemple, celui d’un « accident industriel » célèbre : les turbines à gaz GT24/GT26 d’Alstom qui se sont avérées défectueuses au début des années 2000. Pourquoi des engins aussi coûteux et complexes ont-ils été mis sur le marché sans être testés de fond en comble (ce qui aurait évité de commercialiser des turbines de grande puissance comportant un défaut de conception) ?

Tout simplement parce qu’il aurait fallu laisser tourner ces turbines pendant des années (quatre à cinq ans minimum !) avant que le défaut ne se manifeste… La rentabilité du programme ne pouvait s’accommoder de tests aussi longs, la direction de l’époque a donc pris le risque de se contenter des tests habituels qui étaient tout à fait satisfaisants…

La vraie différence entre capacités et fonctionnalités

Ceci permet de comprendre pourquoi les tests jouent un rôle clé dans la lenteur de l’évolution du logiciel et font avancer l’informatique à deux vitesses : très vite sur le plan du matériel, très lentement sur le plan du logiciel. Le matériel n’amène pourtant que des capacités (autrement dit, des fonctionnements potentiels) alors que c’est le logiciel qui apporte les vraies fonctionnalités (qui elles débouchent sur des traitements bien réels)… Cependant, on peut constater tous les jours que l’accroissement constant des capacités et des performances du côté matériel (ainsi que la baisse des prix qui en résulte) suffit à obtenir des avancées spectaculaires dans bien des domaines. Si on avait dit à un ingénieur électronicien des années soixante-dix que nos adolescents écouteraient un jour de la musique sur des smartphones équipés de mémoires de plusieurs centaines de gigaoctets, il aurait eu du mal à le croire !