Actuellement, l’intelligence artificielle (IA) est vraiment à la mode : les médias en parlent et le sensationnel est systématiquement au rendez-vous. L’IA surmonte défi après défi, tout semble de nouveau possible grâce au deep learning. Tous les articles qui traitent de ce sujet utilisent systématiquement ce terme, sans vraiment l’expliquer (il ne faut pas trop en demander aux médias…).

Les exploits de cette technique miraculeuse ne se comptent plus : IBM et Google triomphent des experts de Jeopardy (jeu télévisé américain où “Watson” d’IBM gagne face à deux vétérans) et du traditionnel Go (le traditionnel jeu de plateau qui semblait pourtant un défi bien plus ardu que les échecs et où Alphago de Google Deepmind réussit à battre le super champion coréen Lee Sedol). Reconnaissance d’images, interface vocale, voitures et camions autonomes, génération d’articles, les applications du deep learning paraissent sans limite, c’est le nouveau printemps de l’IA !

Cet essor s’accompagne aussi de graves questions et de dangers représentés par la montée de l’IA et des robots… nos emplois sont-ils menacés ?

Et même, le destin de l’humanité tout entière pourrait-il être interrompu par une IA atteignant et dépassant le stade de “l’intelligence générale” pour nous laisser sur place et nous balayer sans hésiter comme nous nous débarrassons des espèces dites “nuisibles” ?

Hivers et printemps de l’IA se succèdent

Pour ceux qui sont assez âgés pour s’en souvenir, on a déjà connu cela… c’était en plein coeur des années quatre-vingt avec les systèmes experts. Là aussi, la presse promettait un avenir radieux pour ces logiciels et les “cogniticiens” qui sauraient les mettre en oeuvre.

Résumons rapidement cet épisode en reprenant depuis les débuts de l’IA :

Le terme « d’Intelligence artificielle » remonte aux années cinquante (lors de l’été 1956, une conférence au Darmouth college marque les débuts “officiels” de la discipline) et est attribué à Marvin Minsky du MIT, avec en particulier son article intitulé « Steps toward Artificial Intelligence ». On distingue trois périodes dans l’histoire de l’IA :

- de 1952 à 1969 : c’est la période euphorique, on annonce le remplacement des experts humains par des systèmes experts !

- de 1969 à 1988 : on commence à comprendre la difficulté de la tâche… Et le remplacement des experts humains par des systèmes experts est un échec (sauf dans quelques cas bien spécifiques et particulièrement adaptés).

- de 1988 à 1993, c’est l’hiver de l’IA : ralentissement des recherches en IA à cause des promesses non tenues.

Comment est-on passé aussi vite d’une euphorie exubérante à une déception catastrophique ?

Pour comprendre le “péché originel” de cette discipline, il faut savoir que, dès sa naissance, les partisans de l’IA ont proclamé qu’il fallait programmer “autrement” et pour justifier cette différence, ont proféré des promesses exagérées. C’est souvent le cas dans les domaines techniques et scientifiques : pour obtenir des crédits, si vous êtes un spécialiste (du climat, par exemple), vous allez dire que la situation est grave et qu’elle nécessite des recherches, donc de l’argent pour les mener à bien, pour approfondir (vous n’obtiendrez jamais aucun fond sans dramatiser la situation).

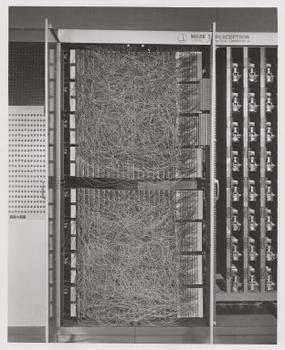

Donc, en 1958, lors d’une conférence de presse, Rosenblatt (un des “pères fondateurs” de l’IA) expliqua que le Perceptron représentait “un embryon d’un ordinateur électronique qui pourra marcher, parler, voir, écrire, se reproduire et être conscient de son existence.” Rien que cela (et en 1958 !)…

Cette exagération (pour ne pas écrire “ce mensonge éhonté !”…) s’est répétée encore et encore tout au long de l’histoire de l’IA. Dans les années quatre-vingt, c’est principalement autour de la notion de « système expert » (SE) que le nouveau « drame » s’est noué. Revenons donc rapidement sur cette notion

Des systèmes experts pour tout, partout !

Historiquement, le premier “système expert” fut Dendral en 1965, créé par les informaticiens Edward Feigenbaum, Bruce Buchanan, le médecin Joshua Lederberg et le chimiste Carl Djerassi. Il permettait d’identifier les constituants chimiques d’un matériau à partir de spectrométrie de masse et de résonance magnétique nucléaire. Le plus connu fut certainement Mycin en 1972-1973 : un “système expert” de diagnostic de maladies du sang et de prescriptions de médicaments, avec un vrai moteur d’inférences et une vraie base de règles. C’est Mycin qui a popularisé la notion et qui lui a donné ses premiers éléments de -relative- crédibilité. Après ce premier succès partiel, il y eut un phénomène d’emballement qu’on retrouvera presque toujours dans les modes techniques qui vont se succéder… Les “systèmes experts” ont eu leur heure de gloire dans les années quatre-vingt, où l’on a trop rapidement pensé qu’ils pourraient se développer massivement. Les startups et les projets se sont multipliés et les “systèmes experts” allaient être partout, devaient être partout !

On imaginait utiliser des SE dans tous les domaines, y compris dans la gestion des entreprises : décisions d’investissements, accords des prêts dans les banques, indemnisations des sinistres dans les assurances, etc. Le domaine et le potentiel semblaient aussi vastes que l’informatique tout entière !

En pratique, le développement de ce genre d’application s’est révélé complexe, car lorsque l’on dépasse la centaine de règles, il devient difficile de comprendre comment le système expert « raisonne » (le “moteur d’inférence” manipule faits et règles en temps réel), et donc d’en assurer la mise au point finale puis la maintenance. Quelques échecs retentissants ont permis de refréner l’enthousiasme des plus fervents. Le projet Sachem (Système d’Aide à la Conduite des Hauts fourneaux En Marche, chez Arcelor), opérationnel dans les années 1990, a été l’un des derniers projets de type « système expert » à avoir vu le jour et à fonctionner avec succès. Il a été conçu pour optimiser le pilotage des hauts-fourneaux en analysant les données fournies en temps réel par un millier de capteurs (Sachem permet d’économiser environ 1,70 euro par tonne de métal produite). Pour arriver à ce résultat, le projet a tout de même coûté environ 30 millions d’euros entre 1991 et 1998…

C’est principalement dans les jeux vidéo que l’intelligence artificielle s’est réfugiée après le relatif flop des systèmes experts.

Du Perceptron au deep learning en passant par les réseaux de neurones…

Aujourd’hui, l’IA fait un retour en force remarqué grâce au deep learning évoqué à tout propos. Mais cette technique est relativement ancienne en fait !

Les réseaux de neurones ont déjà une longue histoire. Ils étaient expérimentés au moment du printemps de l’IA des années 80. Pourtant, ils remontent aux années cinquante, lors des tout débuts de l’IA avec le fameux Perceptron (voir à https://fr.wikipedia.org/wiki/Perceptron) qui, déjà, permettait d’envisager l’apprentissage des machines de façon autonome. L’IA depuis ses débuts, a toujours été partagée entre deux écoles de pensée : celle qui prône la programmation des systèmes (et qui déboucha sur les systèmes experts) et celle qui repose sur l’apprentissage autonome ou assisté de ces mêmes systèmes (dont le Perceptron est la première mise en application).

Le Perceptron a fait ses preuves et les recherches en la matière n’ont jamais vraiment cessé pour déboucher sur le réseau de neurones dans les années quatre-vingt (les réseaux de neurones reprennent le principe du Perceptron tout en multipliant les couches et en se contentant d’une simulation logicielle, plus facile à mettre en oeuvre, mais gourmande en ressources système…). Alors pourquoi a-t-il fallu attendre ces dernières années pour qu’on en parle comme d’une réussite éclatante ?

Tout simplement à cause du “syndrome de l’avion au décollage”… Je vais vous expliquer cela !

Si l’avion ne décolle pas, ça s’arrête là…

Les réseaux de neurones ont été catalogués comme étant “une théorie intéressante mais inapplicable”.Lors des essais menés pendant les années quatre-vingt, on manquait de deux ingrédients indispensables : des échantillons de données en quantité suffisante et les ressources machines nécessaires pour les faire fonctionner (les programmes à base de réseaux de neurones) dans des conditions acceptables. En clair, il manquait de données et même les superordinateurs du moment (genre Cray-One) n’étaient ni assez nombreux ni assez puissants pour ces réseaux gourmands et exigeants. C’est pour cela qu’on parle de syndrome de l’avion au décollage : vous pouvez avoir conçu le profil d’aile le plus performant qu’on puisse imaginer, si vous n’avez pas de moteur assez puissant pour aller avec, votre avion va rouler sur la piste, mais ne décollera pas, même avec de multiples tentatives. Et comme il ne vole pas, on ne peut pas se rendre compte que votre aile est ultra performante… CQFD.

En l’absence de ces ingrédients, les réseaux de neurones sont restés une curiosité de laboratoire, et alors que les systèmes experts s’effondraient, l’IA entrait dans un nouvel hiver qui dura deux décennies.